마크 저커버그가 이끄는 메타가 인공지능(AI) 기술의 새로운 가능성을 제시했다. 메타는 4월 30일(현지시간) 이미지, 영상, 오디오, 깊이, 열, 공간 이동 등 6가지 감각 정보를 통합하는 멀티모달 AI 모델 ‘이미지바인드(ImageBind)’를 공개했다.

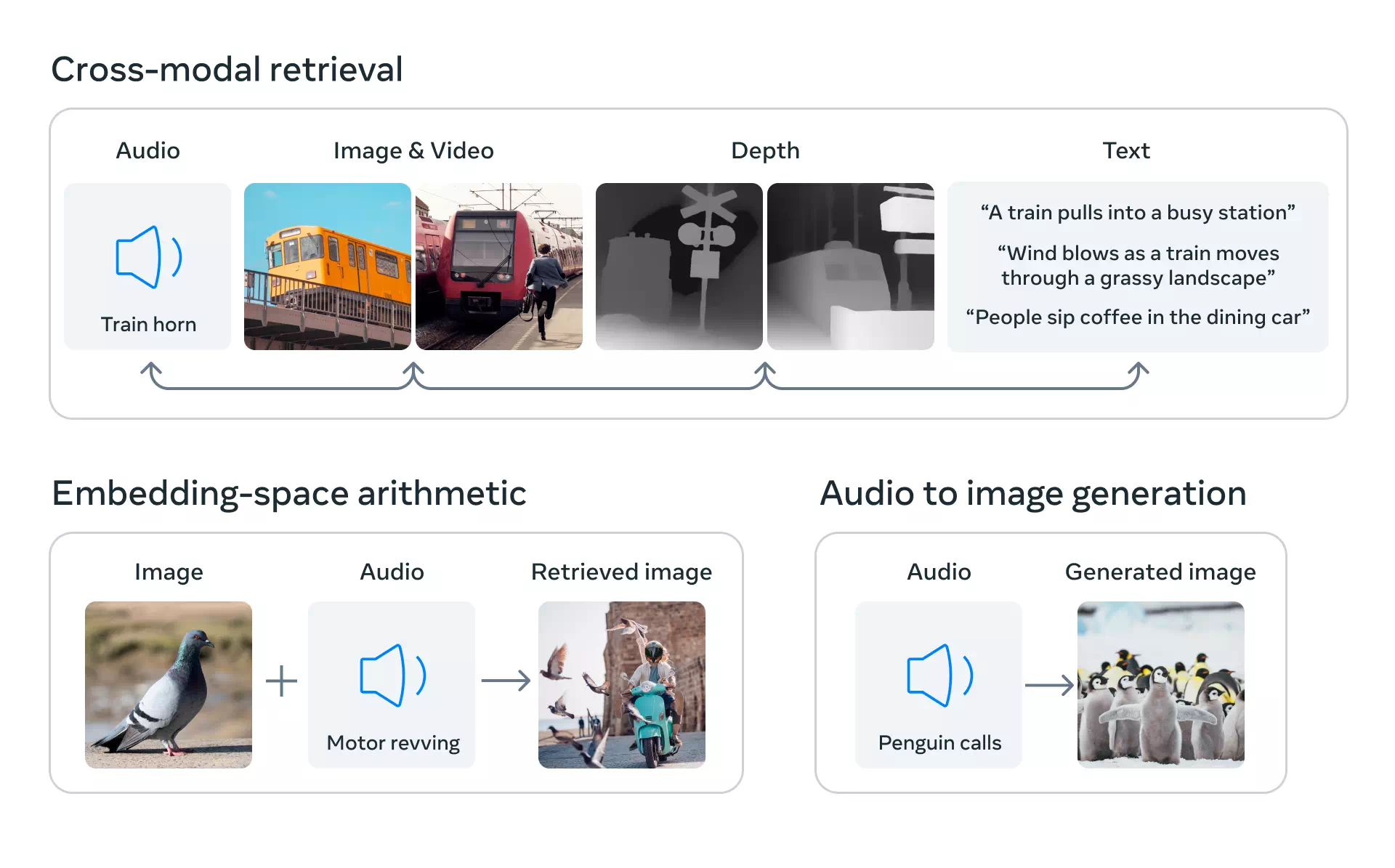

이미지바인드는 메타 AI 연구 조직의 프로젝트로, 다양한 감각 데이터를 하나의 통합된 표현 공간으로 연결함으로써 기존의 이미지·텍스트 중심 생성형 AI보다 더 풍부하고 몰입감 있는 경험을 가능케 한다는 점에서 주목받고 있다.

AI가 감각을 ‘묶는다’

이미지바인드는 이미지와 오디오, 3D 공간 이동 데이터(IMU), 열 이미지, 깊이 정보 등을 병렬적으로 학습해, 서로 다른 데이터 간 의미 있는 연관성을 파악하고 결합할 수 있도록 설계됐다.

예를 들어 호랑이 사진과 폭포 소리를 입력하면, 이 둘을 자연스럽게 통합한 새로운 비디오를 생성할 수 있다. ‘작은 생물’이라는 텍스트, ‘열대 우림’ 이미지, ‘비 내리는 소리’ 오디오, 특정 생물의 움직임 정보(IMU)를 결합하면 몰입형 멀티미디어 콘텐츠가 완성된다.

가상현실부터 디지털 기억 검색까지

메타는 이미지바인드가 향후 몰입형 가상 환경(VR/AR) 개발은 물론, 다양한 센서 데이터를 통합하는 지능형 시스템 구축에도 활용될 수 있을 것으로 내다보고 있다. 예컨대 텍스트와 이미지, 소리, 움직임 데이터를 함께 학습한 AI는 디지털 콘텐츠를 보다 정밀하게 검색하고, ‘디지털 기억’을 탐색하는 시스템으로도 발전할 수 있다.

이미지바인드는 현재 테스트 단계에 있으며, 메타는 향후 오픈소스 공개를 통해 다양한 연구·산업 영역에서 활용될 수 있도록 지원할 계획이다. 메타는 이번 발표가 “AI의 멀티모달 진화 흐름에서 중요한 진전”이라고 강조했다.